یوروپل (آژانس اتحادیهی اروپا برای همکاری در اجرای قانون) بیانیهای منتشر کرده است تا نحوهی استفادهی مجرمان سایبری از چتباتهای پیشرفتهی هوش مصنوعی را تشریح کند و نسبتبه خطراتی که پیشرفت هوش مصنوعی بههمراه میآورد، هشدار دهد. آمار نشان میدهد مجرمان سایبری بهطور روزافزون در حال استفاده از چتباتهایی مثل ChatGPT و Google Bard هستند تا مردم را فریب دهند.

بر اساس گزارش دیجیتال ترندز، یوروپل میگوید استفادهی مجرمان سایبری از هوش مصنوعی سه نگرانی مهم در پی دارد. اولین نگرانی مربوطبه کلاهبرداری و مهندسی اجتماعی است. در این روش، مجرمان برای قربانیان خود ایمیل میفرستند و آنها را به دانلود فایل حاوی بدافزار یا کلیک روی لینک وبسایتهای مخرب ترغیب میکنند.

ایمیلهای فیشینگ بهطور معمول پر از اشتباهات گرامری و املایی هستند و وارد پوشهی اسپم ایمیلها میشوند. حتی آنهایی که راه خودشان را به پوشهی اینباکس پیدا میکنند، بهگونهای نوشته شدهاند که فیشینگبودن آنها معمولا قابلتشخیص است. با اینحال چتباتهای هوش مصنوعی میتوانند متنهایی با دقت گرامری بسیار بالا بنویسند. بهلطف این چتباتها، مجرم سایبری میتواند ایمیلهایی متقاعدکننده برای اهدافش ارسال و نظر آنها را جلب کند.

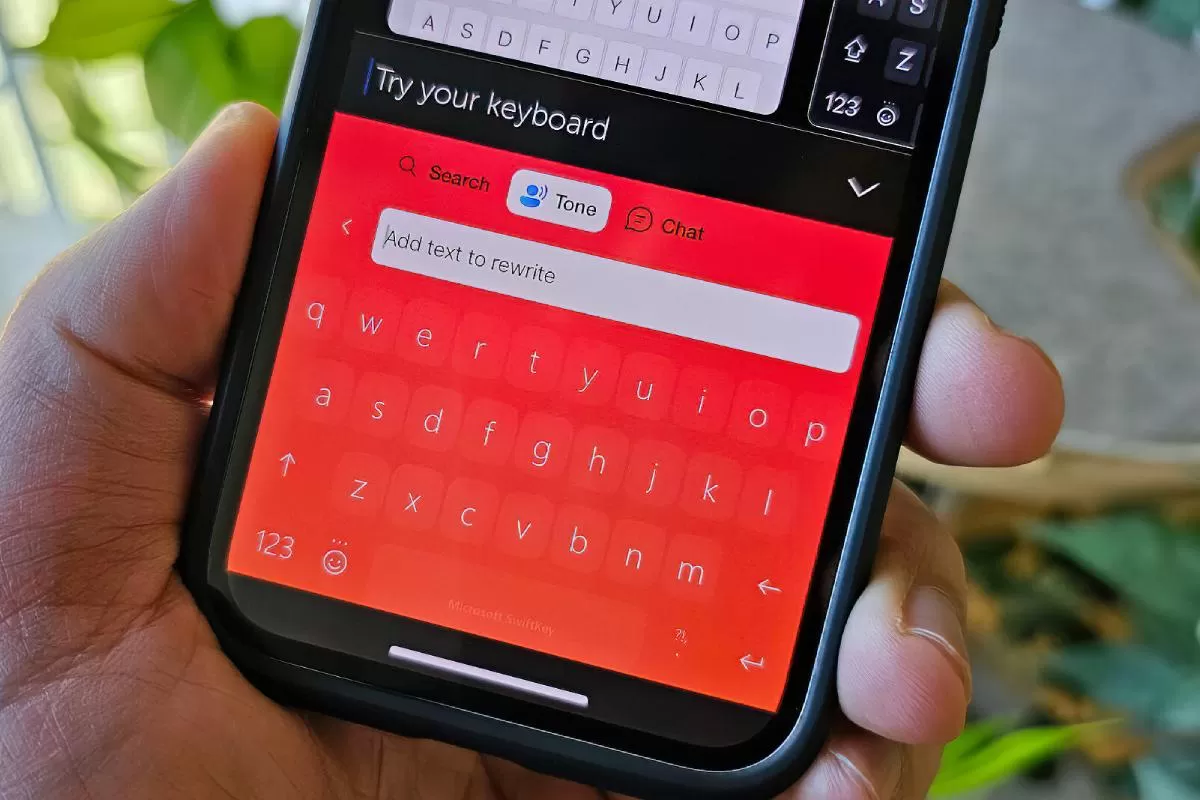

یوروپل میگوید چتباتهای پیشرفتهی امروزی میتوانند الگوهای زبانی را با دقت بالا بازتولید کنند و متنها را با لحنی مشابه افراد یا گروههای خاص بنویسند. به گفتهی یوروپل، مجرمان میتوانند از چنین قابلیتی در مقیاس زیاد استفاده کنند و قربانیان را فریب دهند.

چتباتهای هوش مصنوعی روی پخش اطلاعات گمراهکننده نیز تأثیر میگذارند. این سرویسها میتوانند متنهای بینقصی را که علمی و دقیق بهنظر میرسند با سرعت بالا بنویسند: «این باعث میشود مدل هوش مصنوعی برای پروپاگاندا و پخش اطلاعات نادرست، ایدئال باشد.»

نگرانی سوم یوروپل به توانایی چتباتهای هوش مصنوعی در حوزهی کدنویسی برمیگردد. مجرمان سایبری از این قابلیت برای ساخت بدافزارها بهره میگیرند: «ChatGPT افزونبر تولید متنهای انسانگونه، میتواند کد را با چند زبان برنامهنویسی مختلف بنویسد. برای مجرمی که دانش فنی اندکی داشته باشد، ChatGPT منبعی ارزشمند برای تولید کد مخرب است.»

به عقیدهی یوروپل، وضعیت فعلی بیانگر «چشماندازی ترسناک» برای نهادهای قانونی است، چون شناسایی فعالیتهای مجرمانهی آنلاین دشوارتر میشود.